目录

参考: https://towardsdatascience.com/understanding-latent-space-in-machine-learning-de5a7c687d8d

隐(潜)空间

什么是隐空间?

数据压缩的表示。 学习数据的特征并简化数据表示以寻找模式(pattern)。

数据压缩用比原来更少的比特对信息编码。如19维到9维。

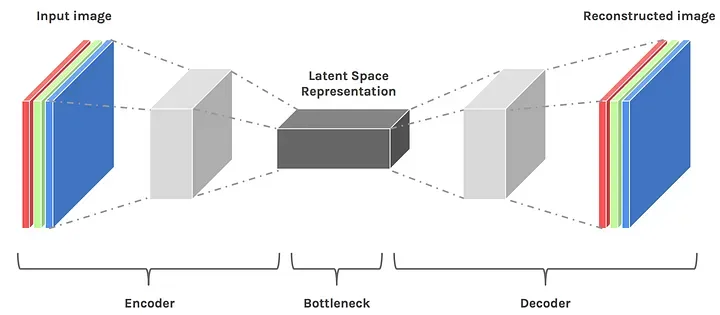

如果训练一个模型,使用完全卷积神经网络(FCN)对图像提取特征。模型通过数据点学习时,降维有损压缩。然后再增加维度。模型学习时,学习每一层边缘角度等特征,将特征组合做特定输出。

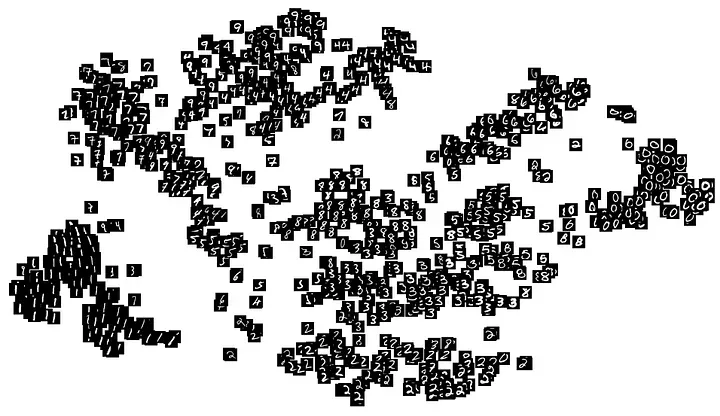

Latent space representation 隐空间绘制

Latent space representation 隐空间绘制

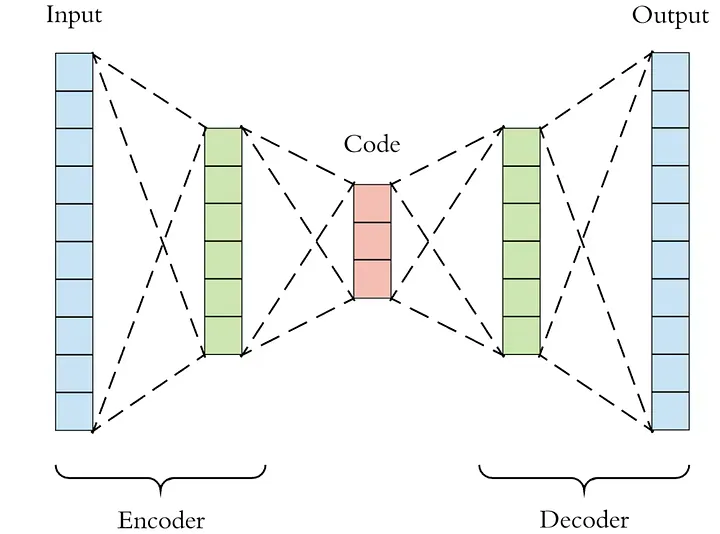

输入时降维,解码器输出是由于需要重建(reconstructed)压缩数据,所以必须存储相关信息并忽略噪声,删除无关信息,保留重要信息。

这种压缩状态是隐空间的表示

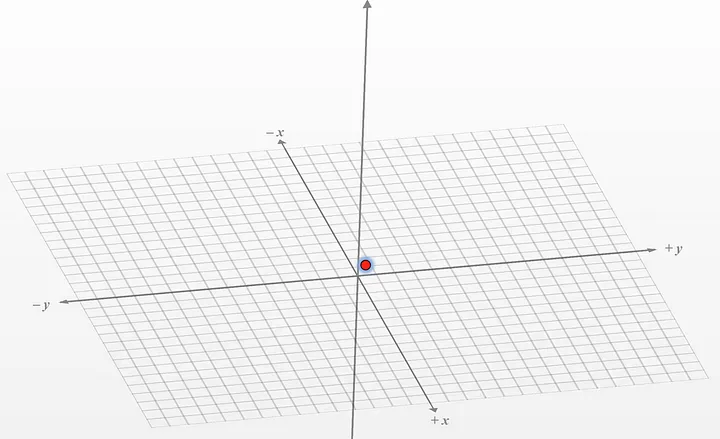

隐空间的空间是什么?

隐空间的作用?

图像处理,生成模型。

自动编码器和生成模型

为什么做这个模型,如果只是为了输出自己那没意义。 但是,我们不关心模型输出什么而关心过程中模型 学到什么。

如果让模型变为恒等函数,我们强制将它数据所有相关特征用 压缩表示层(compressed representation) 表示,使得 压缩表示层有足够信息,以便准确重建。 这种压缩表示层是隐空间表示层,如上图红色区域。

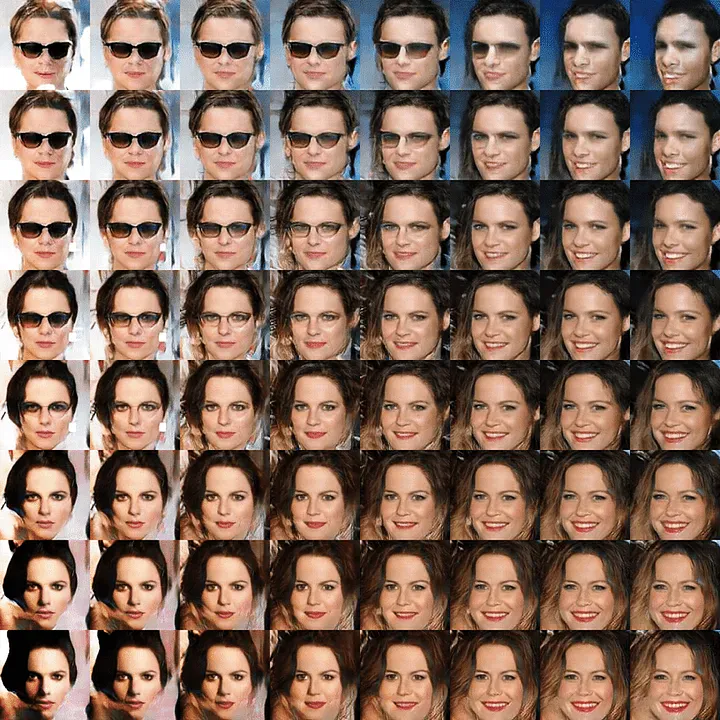

隐空间中两种类型的椅子之间的线性插值示例。

隐空间中两种类型的椅子之间的线性插值示例。

本文作者:墨洺的文档

本文链接:

版权声明:本博客所有文章除特别声明外,均采用 BY-NC-SA 许可协议。转载请注明出处!

目录